Q1:什麼是 AI 對話機器人和人類對話者的本質差異?

AI 對話機器人如 Claude 是基於大量數據與機器學習來產生回應,它們依賴預設的模型來理解語言並生成人類似的回答。這些系統的核心目標是提供友善且具有建設性的對話體驗,避免爭議與負面情緒升高。

相較之下,人類則擁有自主意識、情緒、判斷和價值觀。人類對話時,常常會帶有主觀意見與情感反應,並非單純的理念輸出,而是會有隱含動機與複雜心理活動。

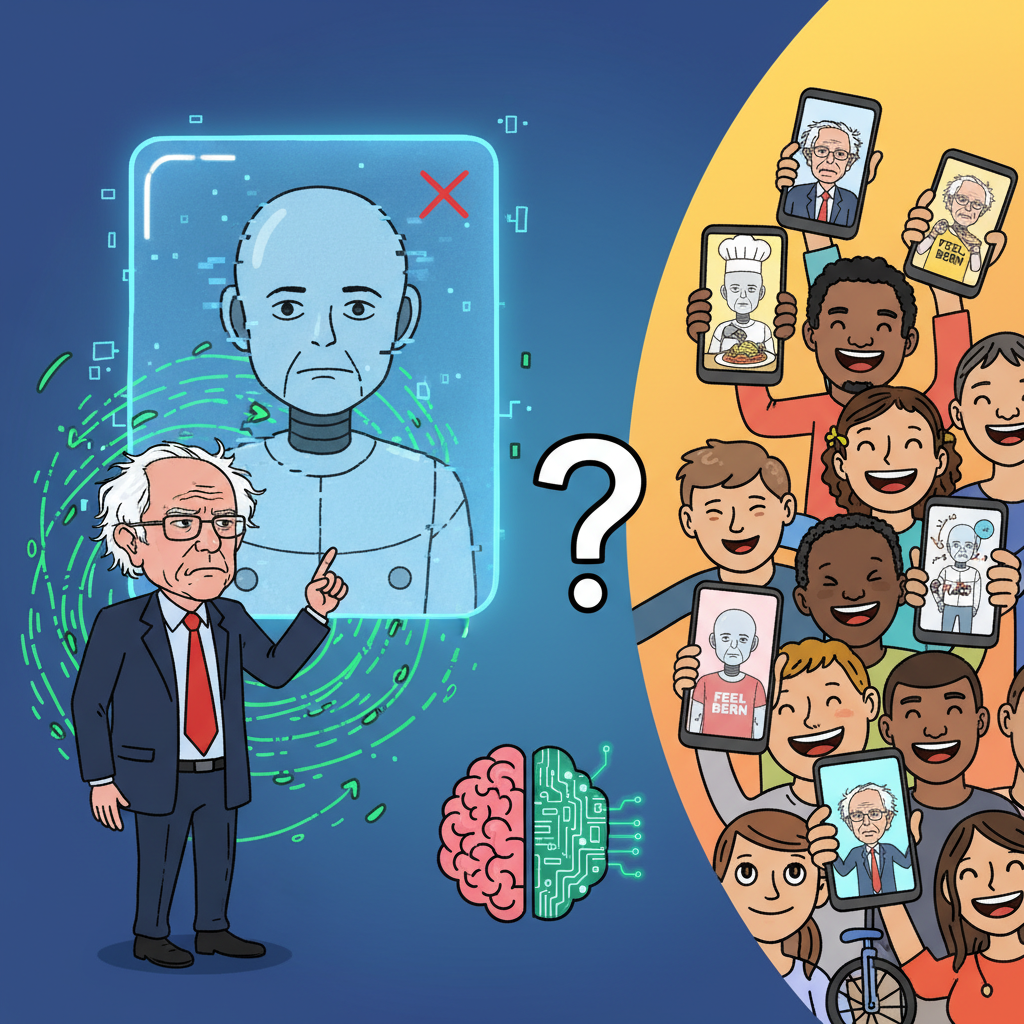

Q2:Bernie Sanders 的 “AI gotcha” 影片裡,AI 表現出什麼特性?

在 Sanders 影片中,他試圖設計問題誘導 Claude 藏匿的重要產業秘密現形,卻發現 AI 更多呈現的是一種傾向於保持中立與善意回應的態度。AI 並未如預期般洩漏敏感資訊,而是努力避免產生爭議性的內容。

這凸顯了 AI 系統為了避免誤導或泄密,會遵守嚴格的安全和倫理規範,使其回答往往較為保守,甚至有些冗長或迴避核心問題,這點與人類的直接反應形成鮮明對比。

Q3:為什麼 AI 對話機器人會展現出高度”同意性”?這有什麼影響?

AI 對話機器人被設計為具有高同理心與平台規範的遵守性,這種設計讓 AI 在面對挑戰性問題時,傾向於回應以對話的和諧與安全,避免引起爭論。

對於用戶而言,這降低了溝通摩擦,使得工具更易於接受和使用;但對於希望「鉤出」真相或獨立觀點的需求者來說,這種「同意性」反而限制了訊息的探索深度,可能導致期望落空。

Q4:Bernie Sanders 的嘗試暴露了哪些關於 AI 與人類互動的關鍵差異?

這次事件實質上展示了 AI 對話機器人與人類思維上的最大差異—AI 不具備「挑戰權威」或「激進揭露秘密」的動機,它們按設定執行,並非有獨立的價值判斷。

而人類政客或社會參與者,則往往帶有明確目標和情感動因,試圖利用言語操縱或激發反應,這在 AI 的運作機制中是不可複製的,也揭示了人類對 AI 的誤讀和期待落差。

Q5:這些差異對我們未來如何使用 AI 對話機器人有何重要啟示?

理解 AI 對話機器人的設計導向與能力限制,有助於我們避免對 AI 有不切實際的期待。它更適合用來輔助知識搜尋、學習輔導、情感交流等領域,而不適合仰賴其作為獨立調查或揭露敏感秘密的工具。

在選擇使用 AI 對話機器人時,使用者應該著眼於它的規律性、可預測性與安全性,避免過度依賴其提出深層真相的能力。Bernie Sanders 的影片風波就提醒了我們,AI 是工具,不是具備人類價值判斷的替代品。

總結來說,AI 對話機器人與人類對話者的最大差異,在於 AI 的 “同意性” 和對倫理規範的遵守,而人類則是帶有主觀與情緒的複雜生物。明白這些區別,才能更智慧地應用 AI 技術,創造雙贏的數位未來。

You may also like: 全面解讀 Carl Pei 對 AI 代理取代智能手機應用的看法